শিশু নির্যাতন অ্যালগরিদম: নিরাপত্তার নতুন প্রতিশ্রুতি নাকি গোপনীয়তার অদৃশ্য ঝুঁকি!

- Author,

- Role, জাগরণ নিউজ বাংলা

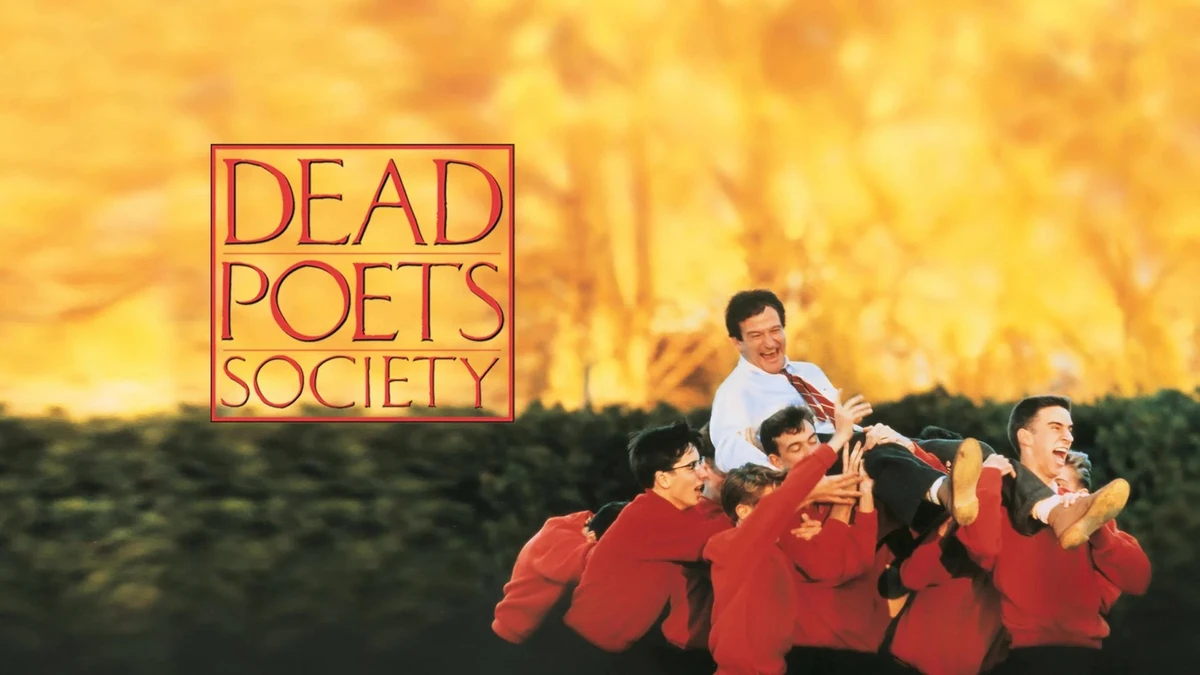

বিশ্বজুড়ে প্রতিদিন যে পরিমাণ শিশু নির্যাতনের ঘটনা ঘটছে, তা এখন এক সামাজিক মহামারীতে পরিণত হয়েছে। একদিকে আইন, সামাজিক প্রচারণা ও সচেতনতা। অন্যদিকে প্রযুক্তির দ্রুত বিকাশ, সবকিছুর মাঝেও শিশুদের প্রতি সহিংসতা যেন থামছেই না।ঠিক এই সময়েই গবেষকরা নজর দিয়েছেন এক নতুন পথে 'Child Abuse Prediction Algorithm', অর্থাৎ এমন এক কৃত্রিম বুদ্ধিমত্তাভিত্তিক সিস্টেম যা শিশু নির্যাতনের সম্ভাবনা বা ঝুঁকি আগেভাগেই শনাক্ত করতে পারবে।

এই প্রযুক্তির মূল ধারণা হলো- মানুষের আচরণ ও পরিবেশের তথ্য বিশ্লেষণ করে এমন একটি মডেল তৈরি করা, যা পূর্বাভাস দিতে পারে কোন শিশু নির্যাতনের ঝুঁকিতে রয়েছে।অ্যালগরিদমটি শিশুদের সম্পর্কিত বিভিন্ন তথ্যের উপর নির্ভর করে। যেমন:

স্কুলে উপস্থিতি বা অনুপস্থিতির ধরণ, সামাজিক যোগাযোগের পরিবর্তন, আচরণ ও মানসিক প্রতিক্রিয়া, স্বাস্থ্য, খাদ্যাভ্যাস, এমনকি পারিবারিক সম্পর্কের ধরন

এই তথ্যগুলো মিলিয়ে একটি বিশ্লেষণাত্মক মানচিত্র তৈরি হয়, যেখানে মেশিন "ঝুঁকিপূর্ণ" ও "ঝুঁকিমুক্ত" শিশুদের চিহ্নিত করে। এরপর সংশ্লিষ্ট সমাজকর্মী বা সংস্থাগুলো হস্তক্ষেপ করে তদন্ত শুরু করে।

AI অ্যালগরিদমটি মূলত মেশিন লার্নিং প্রক্রিয়ায় প্রশিক্ষিত হয়। অর্থাৎ, অতীতের হাজারো বাস্তব ঘটনার তথ্য সিস্টেমে দেওয়া হয়।যেমন- নির্যাতনের ধরন, সময়, পরিবেশ, ভুক্তভোগীর সামাজিক প্রেক্ষাপট ইত্যাদি।তারপর সিস্টেম ধীরে ধীরে শিখে নেয়- কোন ধরণের আচরণ বা পরিবর্তন সাধারণত নির্যাতনের পূর্বাভাস দেয়।যেমন-

⇨ কোনো শিশুর হঠাৎ করে চুপচাপ হয়ে যাওয়া,

⇨ স্কুলে অনুপস্থিত থাকা,

⇨ খাওয়া বা ঘুমের পরিবর্তন,

⇨ আত্মমর্যাদাবোধের অভাব বা ভয় প্রকাশ করা

-এই লক্ষণগুলো যদি একসঙ্গে দেখা যায়, সিস্টেম তা সম্ভাব্য নির্যাতনের 'সিগন্যাল' হিসেবে চিহ্নিত করে।

এই অ্যালগরিদমের সবচেয়ে বড় শক্তি তার বিশ্লেষণ ক্ষমতা। এটি মুহূর্তের মধ্যে লক্ষ লক্ষ ডাটাসেট যাচাই করে সম্ভাব্য প্যাটার্ন খুঁজে বের করতে পারে, যা মানুষের পক্ষে অসম্ভব।কিন্তু একইসাথে এখানেই সবচেয়ে বড় সীমাবদ্ধতাও লুকিয়ে আছে। মেশিনের বিচার পুরোপুরি ডাটার মান ও বৈচিত্র্যের উপর নির্ভরশীল। যদি ডাটা পক্ষপাতদুষ্ট হয়, তবে সিদ্ধান্তও তেমনই হবে। উদাহরণস্বরূপ, যদি অ্যালগরিদমে দরিদ্র বা নিম্নবিত্ত পরিবারের তথ্য বেশি থাকে, তাহলে সিস্টেম সেই শ্রেণিকেই "ঝুঁকিপূর্ণ" হিসেবে বেশি চিহ্নিত করবে। ধনী পরিবারের শিশুদের তথ্য কম থাকায় তারা "নিরাপদ" হিসেবে রয়ে যাবে, যদিও বাস্তবতা তার বিপরীতও হতে পারে। এভাবে প্রযুক্তি অনিচ্ছাকৃতভাবেই তৈরি করতে পারে এক নতুন ধরনের 'ডিজিটাল বৈষম্য'।

শিশুদের তথ্য বিশ্লেষণের এই প্রক্রিয়ায় আরেকটি গুরুতর প্রশ্ন উঠে আসে, তাদের ব্যক্তিগত গোপনীয়তা কি রক্ষিত থাকছে! কারণ, এই অ্যালগরিদম কাজ করতে গেলে শিশুদের স্বাস্থ্য, পারিবারিক ইতিহাস, মানসিক মূল্যায়ন, সব তথ্যই সংগ্রহ করতে হয়। অনেক ক্ষেত্রেই এই তথ্য শিশু বা তাদের পরিবারের অজান্তেই নেওয়া হয়।বিশেষজ্ঞদের মতে, এটি শিশু অধিকার সনদের মূল নীতির পরিপন্থী। কারণ, তথ্যের মালিকানার অধিকার ব্যক্তিরই, শিশুর ক্ষেত্রেও তা সমানভাবে প্রযোজ্য। এছাড়া, ভুল পূর্বাভাসের ঝুঁকিও এখানে বড়। যদি কোনো শিশুকে ভুলভাবে "ঝুঁকিপূর্ণ" হিসেবে চিহ্নিত করা হয়, তবে তা তার মানসিক স্বাস্থ্যের ওপর দীর্ঘমেয়াদে প্রভাব ফেলতে পারে।

AI যত উন্নতই হোক, মানুষের মতো সহানুভূতিশীল সিদ্ধান্ত গ্রহণ তার পক্ষে এখনো সম্ভব নয়। একটি মেশিন তথ্য দেখে বিশ্লেষণ করে, কিন্তু বুঝতে পারে না,একটি শিশুর ভয়ের পেছনে কী গল্প লুকিয়ে আছে। মনোবিজ্ঞানীরা তাই বলছেন, এই অ্যালগরিদম মানুষের জায়গা নিতে পারে না, বরং মানুষকে সহায়তা করার একটি "Early Warning Tool" হিসেবেই থাকা উচিত। অর্থাৎ, এটি কেবল সতর্ক করবে, কিন্তু সিদ্ধান্ত দেবে মানুষই।

ইংল্যান্ড, নেদারল্যান্ডস, কানাডা এবং অস্ট্রেলিয়া-এই দেশগুলো সীমিত পর্যায়ে শিশু নির্যাতন অ্যালগরিদমের পরীক্ষা চালিয়েছে। কিছু ক্ষেত্রে এটি সফলভাবে সম্ভাব্য নির্যাতনের ঘটনা আগেভাগেই শনাক্ত করতে সক্ষম হয়েছে, আবার কিছু ক্ষেত্রে ভুল পূর্বাভাসও দিয়েছে। উদাহরণ হিসেবে ধরা যায়, একটি গবেষণায় দেখা গেছে, সিস্টেমের নির্ভুলতা ছিল প্রায় ৮০ শতাংশ, অর্থাৎ প্রতি ১০০টি পূর্বাভাসের মধ্যে ২০টি ছিল ভুল বা বিভ্রান্তিকর। শিশুদের মতো সংবেদনশীল বিষয়ে এমন সামান্য ভুলও ভয়াবহ প্রভাব ফেলতে পারে।

বাংলাদেশে এখনো এ ধরনের সিস্টেম চালু হয়নি, তবে ধারণাটি গুরুত্বপূর্ণ। দেশের বিভিন্ন সরকারি ও বেসরকারি সংস্থা শিশু নির্যাতন প্রতিরোধে যেভাবে কাজ করছে, সেখানে একটি প্রযুক্তিনির্ভর 'অ্যালার্ট সিস্টেম' শিশু সুরক্ষায় নতুন মাত্রা যোগ করতে পারে।

তবে তার আগে প্রয়োজন-

⇨ শিশু ডাটা সুরক্ষা আইন,

⇨ নৈতিক কাঠামো,

⇨ ডিজিটাল নজরদারির সীমা নির্ধারণ,

⇨ মানবিক প্রশিক্ষণপ্রাপ্ত তত্ত্বাবধায়ক দল।

কারণ, প্রযুক্তি নিজে কখনোই সমাধান নয়। মানুষের সিদ্ধান্তই তার দিক নির্ধারণ করে।

শিশু নির্যাতন অ্যালগরিদম নিঃসন্দেহে ভবিষ্যতের এক সাহসী প্রযুক্তি। এটি আমাদের সমাজকে আরও দায়িত্বশীল করতে পারে। যদি আমরা এটিকে ব্যবহার করি সংবেদনশীলতা ও সচেতনতার সাথে।

তবে ভুলে গেলে চলবে না। মেশিন কখনো অনুভব করতে পারে না একটি শিশুর কান্না, তার ভয়, বা তার নীরবতা। প্রযুক্তি আমাদের সহায়ক হতে পারে, কিন্তু মানবিকতার বিকল্প নয়।আর তাই, এই অ্যালগরিদম যতই নির্ভুল হোক না কেন, শিশু সুরক্ষার শেষ ভরসা মানুষই- তার মমতা, বিবেক আর নৈতিকতা।

আপনার প্রতিক্রিয়া জানান

মন্তব্যসমূহ

এই সংবাদের জন্য এখনো কোনো মন্তব্য নেই।